1.动手学习深度学习课程安排及深度学习数学基础

视频资源B站:动手学习深度学习——李沐

目录

- 目标

- 内容

- 将学到什么

- 1.N维数组样例

- 2.访问2维数组元素

- 3.数据操作

- 4.线性代数

- 5.矩阵计算

- 6.自动求导

目标

- 介绍深度学习景点和最新模型

- LeNet AlexNet VGG ResNet LSTM BERT…

- 机器学习基础

- 损失函数,目标函数,过拟合,优化

- 实践

- 使用pytorch实现介绍的知识点

- 在真实数据上体验算法效果

内容

- 深度学习基础——线性神经网络,多层感知机

- 卷积神经网络——LeNet,AlexNet,VGG,Inception,ResNet

- 循环神经网络——RNN,GRU,LSTM,seq2seq

- 注意力机制——Attention,Transformer

- 优化算法——SGD,Momentum,Adam

- 高性能计算——并行,多GPU,分布式

- 计算机视觉——目标检测,语义分割

- 自然语言处理——词嵌入,BERT

将学到什么

- What

- 深度学习里有那些技术

- How

- 如何实现和调参

- Why

- 背后的原因(直觉,数学)

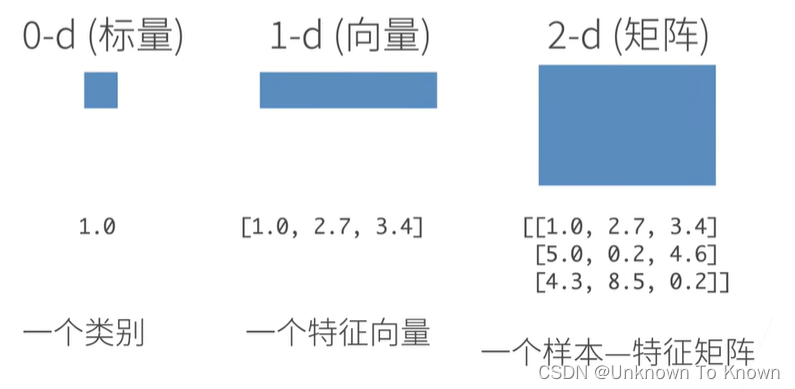

1.N维数组样例

N维数组是机器学习和神经网络的主要数据结构

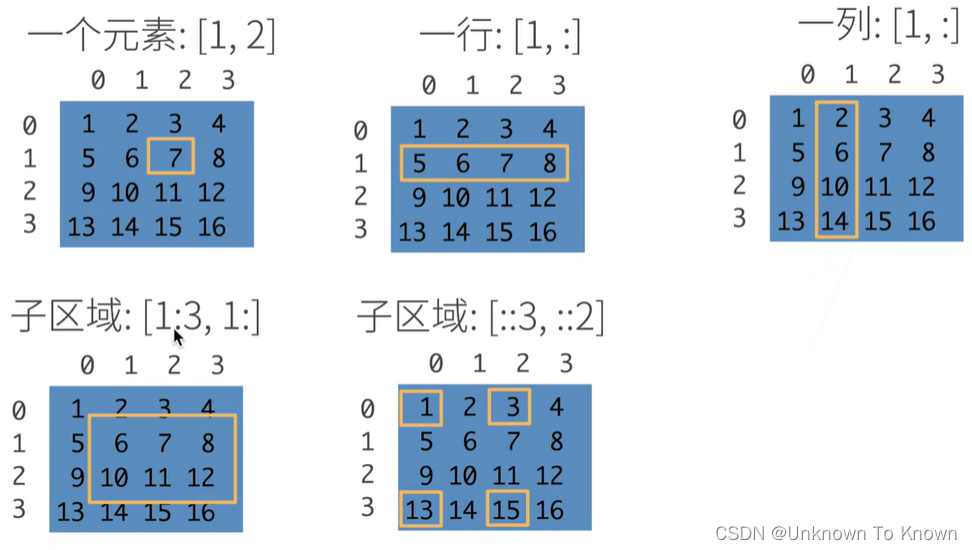

2.访问2维数组元素

3.数据操作

首先,我们导入torch,注意,虽然它被称为pytorch,但我们应该导入torch而不是pytorch

import torch #张量表示一个数值组成的数组,这个数组可能有多个纬度 x = torch.arange(12)#输出:1 2 3 ...12 x.shape#输出:torch.Size([12]) x.numel#输出:12 #要改变一个张量的形状而不改变元素数量和元素值,我们可以调用reshape函数 x = x.reshape(3,4) #输出: 。。。。。。不再过多的描述

4.线性代数

矩阵相当于一个扭曲空间,把下图中的蓝线和绿线,扭曲到不同方向和长度

5.矩阵计算

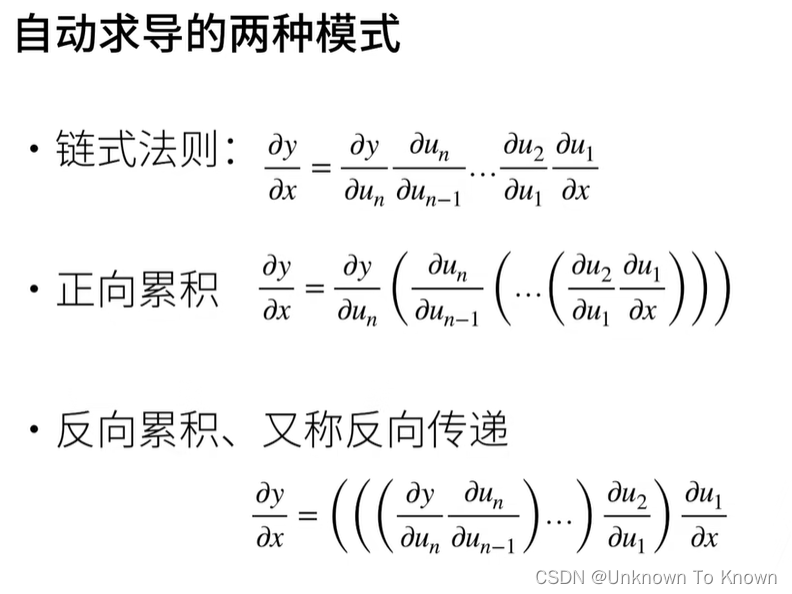

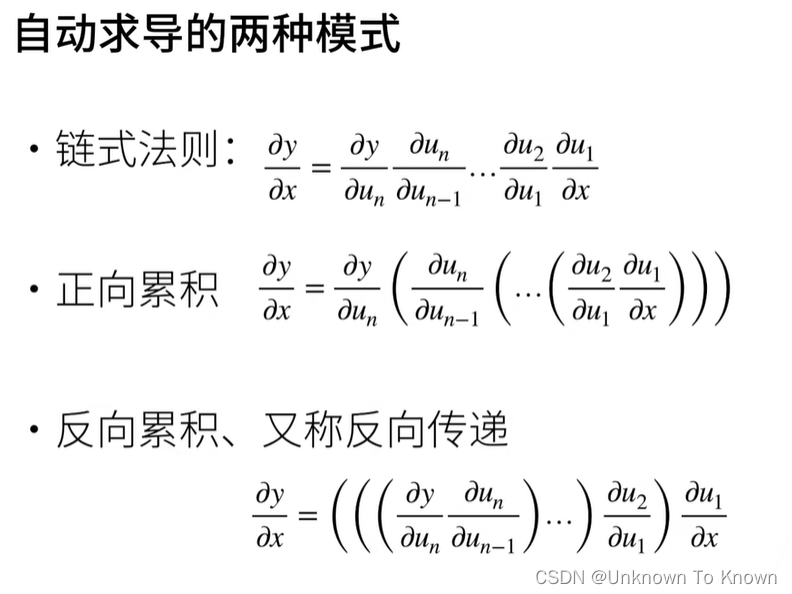

6.自动求导

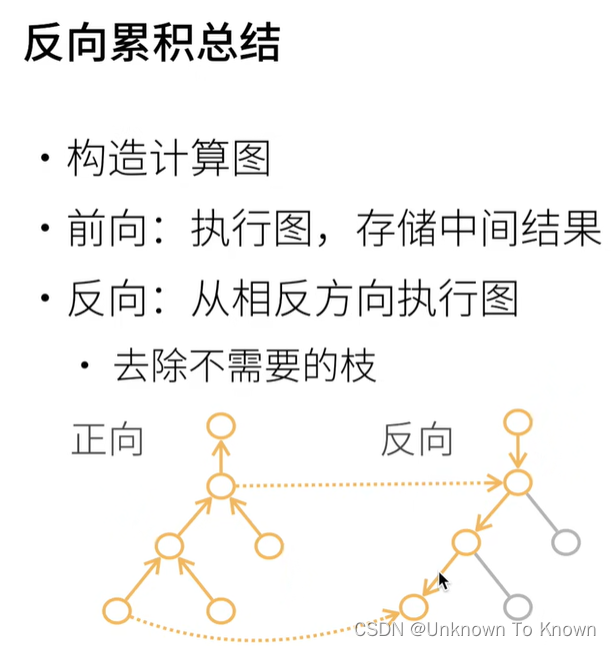

复杂度:

- 计算复杂度:O(n),n为操作字个数

- 通常正向和反向的代价类似

- 内存复杂度:O(n),因为需要存储正向的所有中间结果

- 跟正向累积对比

- O(n)计算复杂度用来计算一个变量的梯度

- O(1)内存复杂度

- 计算复杂度:O(n),n为操作字个数

- 背后的原因(直觉,数学)

- What

- 介绍深度学习景点和最新模型

免责声明:我们致力于保护作者版权,注重分享,被刊用文章因无法核实真实出处,未能及时与作者取得联系,或有版权异议的,请联系管理员,我们会立即处理! 部分文章是来自自研大数据AI进行生成,内容摘自(百度百科,百度知道,头条百科,中国民法典,刑法,牛津词典,新华词典,汉语词典,国家院校,科普平台)等数据,内容仅供学习参考,不准确地方联系删除处理! 图片声明:本站部分配图来自人工智能系统AI生成,觅知网授权图片,PxHere摄影无版权图库和百度,360,搜狗等多加搜索引擎自动关键词搜索配图,如有侵权的图片,请第一时间联系我们,邮箱:ciyunidc@ciyunshuju.com。本站只作为美观性配图使用,无任何非法侵犯第三方意图,一切解释权归图片著作权方,本站不承担任何责任。如有恶意碰瓷者,必当奉陪到底严惩不贷!